Datenzulieferungen standardisieren, aufbereiten und qualitätssichern mit SAP SDI Realtime

Unser Kunde aus dem Finanzbereich wollte Datenzulieferungen in sein Data Warehouse standardisieren und sie in einem zwischengeschalteten HANA System aufbereiten und qualitätssichern. Ziel war es, alles für ein Neartime Reporting im Data Warehouse und Ad Hoc Reportingmöglichkeiten für die Fachbereiche in der HANA DB vorzubereiten.

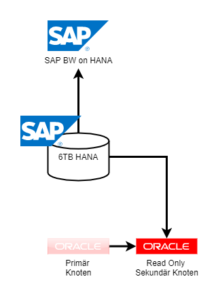

Hier zeigen wir einen Ausschnitt aus der Gesamtarchitektur, die im Rahmen vieler weiterer Projekte umgesetzt worden ist. Im Folgenden lesen Sie, wie wir aus einem Oracle System ca. 700 Tabellen mit einer Quell Größe von ca. 2TB in nahezu Echtzeit angebunden haben und welchen Herausforderungen wir uns hierbei stellen mussten. Zum Zeitpunkt dieses Ausschnittes war bereits ein MSSQL System über Log-basierte Smart Data Integration (SDI) Replikation in die Architektur eingebaut worden.

Herausforderungen: Beladung regulieren – Veränderungen erkennen

Der Zugriff durfte nur auf den Standby Knoten des Oracle Systems stattfinden, um den Hauptknoten nicht zu belasten. Dieser Standby Knoten war nur Read Only geöffnet. Die SAP SDI Standardmöglichkeiten für Realtime erfordern einen Schreibzugriff auf dem Quellsystem. Für die Datenanbindung musste eine Möglichkeit im SAP Kontext gefunden werden, die trotz Read Only Mode des Sekundärknotens eine schnelle Verbindung sicherstellt. Zudem musste für das Folgesystem ersichtlich sein, welche Daten sich durch die Beladung geändert haben.

Lösung - Smart Delta!

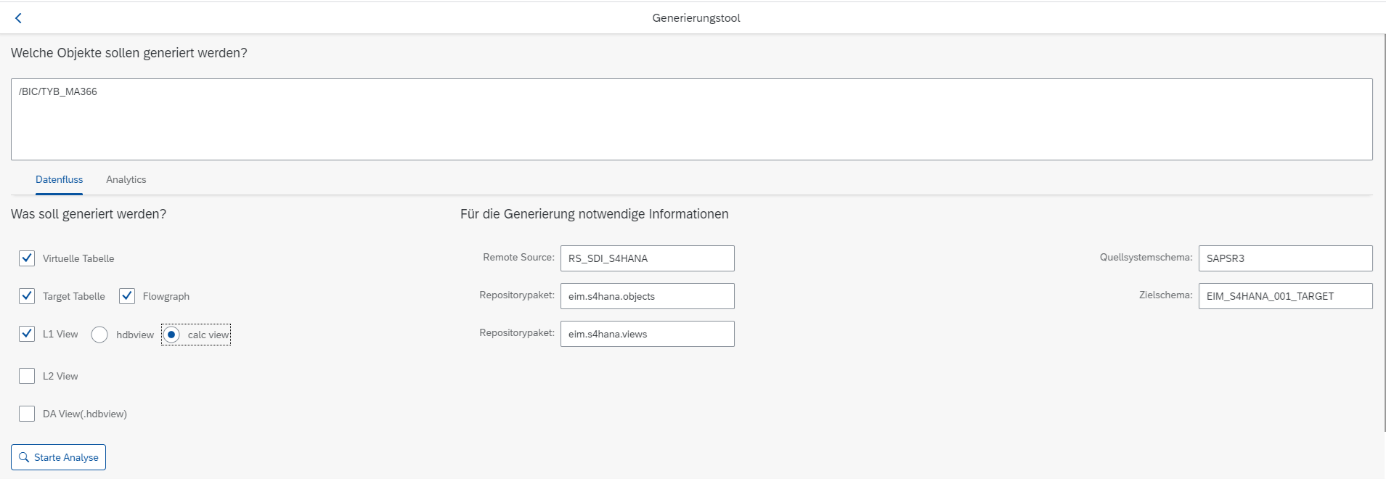

Von der Anbindung mittels SAP SDI bis hin zu einer UI5 App zum Monitoring des Status. Wir haben eine ganzheitliche Lösung entwickelt. Erfahren Sie in den folgenden Schritten, wie die Herausforderungen gelöst wurden.

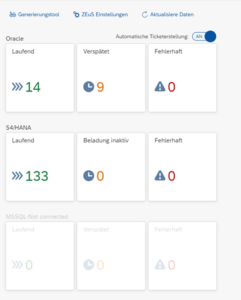

Damit auch der Überblick über den Status der Datenanbindung jederzeit gewährleistet ist, wurde hier ebenfalls eine UI5 App erstellt. Diese ist zusätzlich noch an eine automatische Ticketerstellung in Azure DevOps sowie an einen Mailversand angeschlossen. Gerade durch den Switch des Kunden von HANA 1 auf HANA 2 mit Verbleib auf XS Classic Objekten und dem Wegfall des klassischen Admin Cockpits war ein Überblick über die Replikation dringend nötig. In das Cockpit wurden aber auch weitere Funktionen integriert wie z.B. die T-Shirt Size der Tabellen ändern, die Tabellen Prioritäten festlegen, Tabellengruppendefinition oder schneller Zugriff auf eventuelle Fehlermeldungen.

Alle Bilder auf dieser Seite © 2021. BIG.Cube GmbH. Alle Rechte vorbehalten.

Wiederverwendbarkeit

Fazit

Verfasst von Daniel Fröhler

Beitrag teilen

Weitere spannende Themen aus unserem Newsroom

Wir gehören zu „Deutschlands besten Arbeitgebern“

Als einer der Top-100-Arbeitgeber Deutschlands mit erneuter „Great Place to...

Mehr lesenUnser Herzensprojekt: Die Stiftung AKM in München

Schon seit einiger Zeit unterstützten wir als BIG.Cube GmbH die...

Mehr lesenBIG.Cube ist ein Great Place to Work – Bayern und ITK

Die BIG.Cube wurde dieses Jahr von Great Place to Work...

Mehr lesen